Comment faire une Machine d’Apprentissage Locale ?

CRÉER UNE MACHINE D’APPRENTISSAGE IA LOCALE (MaL) / LOCAL AI TRAINING MACHINE (LtM)

=>

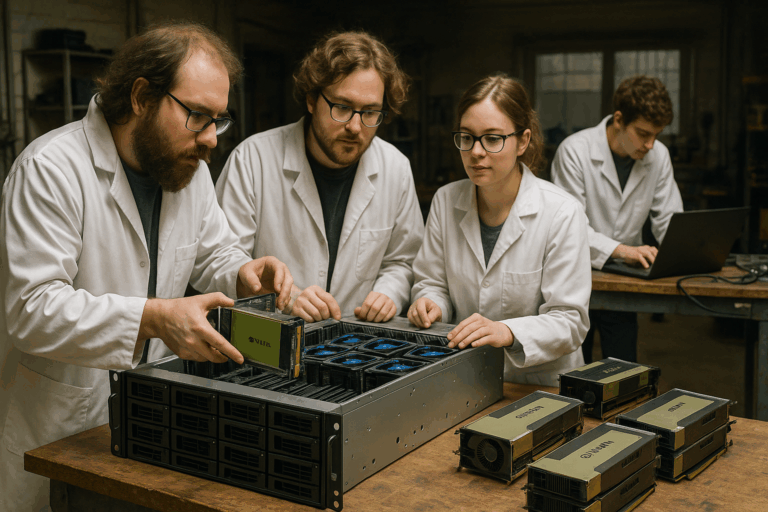

Créer une machine d’apprentissage locale (Local AI Training Machine) implique plusieurs étapes, allant du choix du matériel à l’installation des logiciels et frameworks nécessaires. Voici un guide détaillé pour mettre en place une machine d’apprentissage en local, adaptée à GPT et aux modèles IA génératifs.

1. Choisir le Matériel (Hardware)

L’entraînement des modèles IA, surtout GPT-like, demande beaucoup de puissance.

- Processeur (CPU) : Un Intel i9 / AMD Ryzen 9 ou mieux (mais le GPU est plus important).

- Carte Graphique (GPU) : RTX 6000 ADA / PNY NVIDIA A800 40 GB / PNY NVIDIA L40S – Mémoire (24 Go à 80 Go).

- Mémoire Vive (RAM) : 32 Go minimum, 64 Go recommandé pour des modèles plus grands.

- Stockage (SSD NVMe) : 1 To Mini – 4 To recommandé (pour datasets, modèles, logs).

- Boitier type data center : Armoire réseau, Armoire Serveur 19 Pouces | 4 U |

- Alim 220V : Corsair HX1500i Alimentation ATX Entièrement Modulaire à Très Faible Bruit

Alternative : serveur distant (Google Colab, Lambda Labs, RunPod, OVH…).

COMPOSANTS (Hardware)

💠 Intel i9=

=>

- Intel Core i9-14900K (14th gen) desktop processor.

- Featuring Intel Thermal Velocity Boost, Intel Turbo Boost Max Technology 3.0, and PCIe 5.0 & 4.0 support, DDR5 and DDR4 support.

- Unlocked 14th Gen Intel Core i9 desktop processors are optimized for IA

💠 AMD Ryzen 9

=>

- ARCHITECTURE ZEN 5 – Le nouveau standard pour les joueurs et créateurs. Profitez de performances incroyables ainsi que d’une efficacité énergétique accrue grâce à la nouvelle architecture AMD Zen 4 basée sur une finesse de gravure en 4 nm, une première mondiale

- 12 CŒURS ET 24 THREADS – Le Ryzen 9 9900X offre des fréquences exceptionnelles (Base 4,4 GHz / Boost 5,6 GHz). L’overclocking est bien sûr possible puisque l’ensemble des cœurs sont débridés.

- CARACTÉRISTIQUES AVANCÉES – Avec une un TDP de 120 W, et ses 76 MB Cache L3, le Ryzen 9 9900X est taillé pour accomplir de grandes choses. Il dispose également d’une puce graphique intégrée AMD RDNA 2.

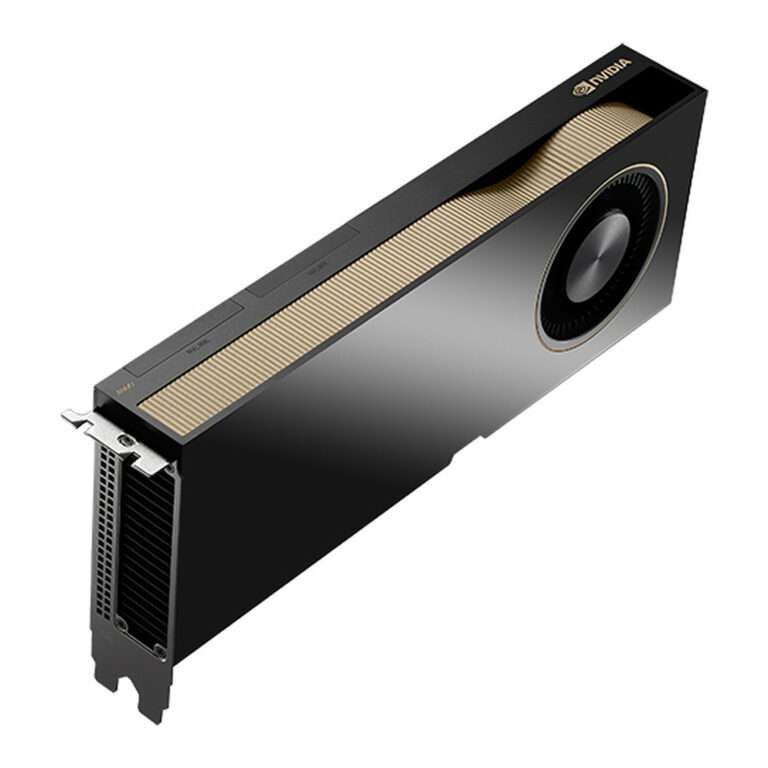

💠RTX 6000 ADA

=>

| coprocesseur graphique | NVIDIA RTX 6000 Ada |

|---|---|

| Mémoire vive de la carte graphique | 48 Go |

| Fréquence d’horloge du processeur | 1 dix millièmes de pouces |

| Interface de sortie vidéo | DisplayPort |

| Type de mémoire vive (carte graphique) | Mémoire GDDR6X |

| appareils compatibles | Ordinateur de bureau |

| résolution maximale de l’affichage | 3840p |

| Interface de la carte graphique | PCI-Express x16 |

💠PNY NVIDIA A800 40 GB

=>

Informations générales | Désignation | PNY NVIDIA A800 40 GB Active |

Marque | ||

Modèle | VCNA800-PB | |

Chipset graphique | Chipset graphique | |

Nombre de GPU | ||

Bus | ||

Mémoire | Taille mémoire vidéo | |

Interface mémoire | ||

Type de mémoire | ||

Architecture | Processeurs de flux | |

Applications | Multi-GPU | |

Utilisation | ||

Connectique | Entrées vidéo | |

Sorties vidéo | ||

Design | Type de refroidissement | |

Consommation | ||

Low profile | ||

Format | ||

Connecteur(s) alimentation | ||

Garanties | Garantie commerciale | 3 ans constructeur |

Garantie légale | Voir les modalités |

💠PNY NVIDIA L40S

=>

| Coprocesseur graphique | NVIDIA |

| Marque | PNY |

| Taille de la RAM graphique | 48 Go |

| Interface de sortie vidéo | DisplayPort |

| Fabricant de processeurs graphiques | NVIDIA |

| Appareils compatibles | Ordinateur de bureau |

| Interface de carte graphique | PCI Express |

| Nom de modèle | L40 Module |

| Description de la carte graphique | Dédié |

| Fabricant | PNY |

💠RAM 32 Go

=>

| Marque | Corsair |

| Taille de la mémoire de l’ordinateur | 32 Go |

| Technologie de mémoire RAM | DDR5 |

| Vitesse de mémoire | 4800 MHz |

| Appareils compatibles | ordinateur portable,ordinateurs portables |

| Caractéristique spéciale | Boost haute fréquence et vitesse automatique |

| Tension | 1,1 Volts |

| Latence stroboscopique d’adresse de colonne | 40 |

| Facteur de forme | SO-DIMM |

| Nom de modèle | CORSAIR VENGEANCE SODIMM |

💠RAM 64 Go

=>

| Marque | Corsair |

| Taille de la mémoire de l’ordinateur | 64 Go |

| Technologie de mémoire RAM | DDR5 |

| Vitesse de mémoire | 4800 MHz |

| Appareils compatibles | Ordinateur portable |

| Caractéristique spéciale | Haute performance |

| Tension | 2 Volts |

| Latence stroboscopique d’adresse de colonne | 40 |

| Facteur de forme | SO-DIMM |

| Nom de modèle | c40 |

💠SSD NVMe 4To

=>

| Capacité du stockage numérique | 4 To |

| Interface du disque dur | NVMe |

| Technologie de connectivité | SATA |

| Marque | Samsung |

| Caractéristique spéciale | Portable |

| Facteur de forme du disque dur | 2,5 Pouces |

| Description du disque dur | Disque SSD |

| Appareils compatibles | Ordinateur portable, Ordinateur de bureau, polycarbonate, Bureau |

| Type d’installation | Disque dur interne |

| Couleur | noir |

💠Boîtier Rack 19″ Format 4U

=>

| Compatibilité de la carte mère | ATX |

| Type de cas | Inconnu |

| Usages recommandés pour le produit | Commercial |

| Couleur | argent |

| Matériau | Acier allié SGCC |

| Type de fixation de l’alimentation | Montage inférieur |

| Méthode de refroidissement | Eau |

| Nom de modèle | UK4339 |

| Taille du ventilateur | 8E+1 Millimètres |

Préambule avant de se lancer…

Process complet pour Installer, Personnaliser et Déployer un Modèle IA en Local

1. Préparer un Environnement IA Local

Objectif

Installer un environnement Python optimisé pour le deep learning et la génération de contenu avec IA (texte, image, audio, vidéo).

Étapes pour Linux / Windows avec WSL

a. Installer Miniconda (ou Anaconda)

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

bash Miniconda3-latest-Linux-x86_64.sh

b. Créer un environnement IA

conda create --name IA_env python=3.10

conda activate IA_env

c. Installer PyTorch avec ou sans GPU

Avec GPU (NVIDIA + CUDA 11.8)

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

Sans GPU :

pip install torch torchvision torchaudio

2. Installer les Outils pour l’IA Générative

Frameworks de base

pip install transformers datasets peft accelerate

pip install diffusers auto-gptq

pip install gradio fastapi langchain

3. Télécharger un Modèle GPT-like et l’Exécuter

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "mistralai/Mistral-7B"

model = AutoModelForCausalLM.from_pretrained(model_name)

tokenizer = AutoTokenizer.from_pretrained(model_name)

input_text = "Bonjour, comment puis-je t’aider ?"

tokens = tokenizer(input_text, return_tensors="pt")

output = model.generate(**tokens)

print(tokenizer.decode(output[0]))

4. Ajouter et Intégrer des Données à un Modèle IA

Étapes générales

Collecte : fichiers CSV, JSON, JSONL, images, audio, texte

Nettoyage : suppression des valeurs manquantes, normalisation

Structure : séparer

train/val/test, équilibrer les classes

Exemple avec Hugging Face :

from datasets import load_dataset

dataset = load_dataset("json", data_files="mon_dataset.jsonl")

5. Fine-tuner un Modèle GPT

from transformers import TrainingArguments, Trainer

training_args = TrainingArguments(output_dir="./fine_tuned_model", per_device_train_batch_size=2)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=dataset

)

trainer.train()

6. Déployer une API ou Interface Web Locale

Avec FastAPI

from fastapi import FastAPI

from transformers import pipeline

app = FastAPI()

generator = pipeline("text-generation", model="mistralai/Mistral-7B")

@app.get("/generate")

def generate(prompt: str):

result = generator(prompt, max_length=100)

return {"response": result[0]["generated_text"]}

Lancement :

uvicorn filename:app --reload

Avec Gradio

import gradio as gr

def generate_text(prompt):

result = generator(prompt, max_length=100)

return result[0]["generated_text"]

gr.Interface(fn=generate_text, inputs="text", outputs="text").launch()

7. Cas Spécifique : IA Générative (Texte, Image, Voix)

Texte – Format JSONL pour GPT

{"messages": [

{"role": "system", "content": "Tu es un expert en IA générative."},

{"role": "user", "content": "Comment ajouter des données à GPT ?"},

{"role": "assistant", "content": "Voici comment tu peux le faire…"}

]}

Images – Stable Diffusion

from diffusers import StableDiffusionPipeline

pipeline = StableDiffusionPipeline.from_pretrained("runwayml/stable-diffusion-v1-5")

pipeline.train("dataset/images/")

pipeline.save_pretrained("model_custom/")

Voix – TTS (Text-to-Speech)

from TTS.api import TTS

tts = TTS("vits", checkpoint_path="model.pth")

tts.train("dataset/voices/")

8. Résumé des Étapes Clés

- Installer un environnement Python optimisé

- Télécharger les frameworks IA nécessaires

- Charger un modèle GPT-like (ex. : Mistral, LLaMA, Falcon)

- Ajouter et structurer des données personnalisées

- Fine-tuner le modèle localement

- Déployer le modèle avec FastAPI ou Gradio

C’est parti !

2. Installer un Environnement IA

Tu as besoin d’un environnement Python optimisé pour le deep learning.

Étapes pour Linux / Windows avec WSL

Installer Miniconda (ou Anaconda)

Bash |

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh bash Miniconda3-latest-Linux-x86_64.sh |

Créer un environnement IA

Bash |

conda create –name AI_env python=3.10 conda activate AI_env |

Installer PyTorch + CUDA (accélération GPU)

Si NVIDIA :

Bash |

pip install torch torchvision torchaudio –index-url https://download.pytorch.org/whl/cu118 |

Si sans GPU :

Bash |

pip install torch torchvision torchaudio

|

3. Installer les Frameworks pour IA Générative

Selon ton projet, voici les principaux outils :

GPT & NLP (Hugging Face, OpenAI, LLaMA, Mistral, Falcon)

Bash |

pip install transformers datasets peft accelerate |

Stable Diffusion (Images IA)

Bash |

pip install diffusers |

Gestion des modèles LLM (Llama, Mistral) avec GPTQ (optimisation)

Bash |

pip install auto-gptq |

Interfaces Locales (Gradio, FastAPI, LangChain)

Bash |

pip install gradio fastapi langchain |

4. Télécharger un Modèle IA et l’Exécuter en Local

Une fois ton environnement IA prêt, tu peux charger et exécuter un modèle GPT-like.

Télécharger un modèle open-source (Ex : Mistral-7B, LLaMA-2, Falcon)

Python |

from transformers import AutoModelForCausalLM, AutoTokenizer model_name = « mistralai/Mistral-7B » model = AutoModelForCausalLM.from_pretrained(model_name) tokenizer = AutoTokenizer.from_pretrained(model_name) |

Lancer un test en local

Python |

input_text = « Bonjour, comment puis-je t’aider ? » tokens = tokenizer(input_text, return_tensors= »pt ») output = model.generate(**tokens) print(tokenizer.decode(output[0])) |

5. Fine-Tuner un Modèle Localement

Si tu veux entraîner ou fine-tuner ton propre modèle GPT en local, voici un exemple.

Charger un dataset personnalisé

Python |

from datasets import load_dataset dataset = load_dataset(« json », data_files=« my_dataset.jsonl ») |

Lancer le fine-tuning

Python |

from transformers import TrainingArguments, Trainer training_args = TrainingArguments(output_dir=« ./fine_tuned_model », per_device_train_batch_size=2) trainer = Trainer(model=model, args=training_args, train_dataset=dataset) trainer.train() |

6. Déployer le Modèle en Local

Si tu veux créer une API ou une interface web locale, utilise FastAPI ou Gradio.

Créer une API avec FastAPI

Python |

from fastapi import FastAPI from transformers import pipeline app = FastAPI() generator = pipeline(« text-generation », model=« mistralai/Mistral-7B ») @app.get(« /generate ») def generate(prompt: str): result = generator(prompt, max_length=100) return {« response »: result[0][« generated_text »]} # Lancer l’API : uvicorn filename:app –reload |

Créer une interface avec Gradio

Python |

import gradio as gr def generate_text(prompt): result = generator(prompt, max_length=100) return result[0][« generated_text »] gr.Interface(fn=generate_text, inputs=« text », outputs=« text »).launch() |

Résumé des Étapes pour une Machine d’Apprentissage Locale

– Choisir le bon matériel (GPU puissant recommandé)

– Installer un environnement Python optimisé

– Télécharger et installer les frameworks IA (Hugging Face, PyTorch, etc.)

– Charger et exécuter un modèle GPT-like

– Fine-tuner le modèle avec des données personnalisées

– Déployer l’IA en local avec une API ou une interface web

=>

=>

AJOUTER DES DONNÉES DANS UNE MACHINE D’APPRENTISSAGE LOCALE

=>

Ajouter des données dans une machine d’apprentissage locale implique plusieurs étapes, que ce soit pour un modèle de machine learning (ML) traditionnel ou un modèle d’intelligence artificielle basé sur le deep learning. Voici comment procéder :

1. Préparer les données

Avant d’entraîner un modèle, les données doivent être nettoyées, organisées et prétraitées.

Collecte des données

- Récupérer des données depuis des sources locales (fichiers CSV, JSON, bases de données, etc.)

- Télécharger des datasets publics (Kaggle, UCI, etc.)

- Générer des données synthétiques si nécessaire

Nettoyage des données

- Supprimer les valeurs manquantes ou aberrantes

- Normaliser et formater les données (échelle, encodage des variables)

Structuration des données

- Séparer les jeux de données en train (80%) / validation (10%) / test (10%)

- Assurer un bon équilibre des classes (pour éviter le biais)

2. Charger les données dans la machine d’apprentissage

Cela dépend des outils et frameworks que vous utilisez :

a) Avec Python (Pandas, NumPy)

Si vos données sont dans un fichier CSV ou une base SQL :

Python |

import pandas as pd # Charger un fichier CSV df = pd.read_csv(« data.csv ») # Afficher un aperçu print(df.head()) |

Avec NumPy pour des matrices de données :

Python |

import numpy as np data = np.loadtxt(« data.csv », delimiter= », ») print(data.shape) |

b) Avec un modèle basé sur Scikit-Learn

Scikit-Learn permet de charger et préparer les données pour l’entraînement :

Python |

from sklearn.model_selection import train_test_split # Séparation des features (X) et des labels (y) X = df.drop(« target », axis=1) y = df[« target »] # Division des données X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) |

c) Avec TensorFlow/Keras pour du Deep Learning

Si vous utilisez TensorFlow/Keras, chargez les données sous forme de tensors :

Python |

import tensorflow as tf # Charger un dataset en mémoire dataset = tf.data.experimental.make_csv_dataset( « data.csv », batch_size=32, label_name= »target », num_epochs=1 ) |

Pour des images :

Python |

from tensorflow.keras.preprocessing.image import ImageDataGenerator datagen = ImageDataGenerator(rescale=1./255) train_data = datagen.flow_from_directory(« images/ », target_size=(128, 128), batch_size=32) |

3. Entraîner le modèle avec les nouvelles données

Une fois les données chargées, entraînez le modèle en local.

✔ Avec Scikit-Learn (Exemple : Régression Logistique)

Python |

from sklearn.linear_model import LogisticRegression model = LogisticRegression() model.fit(X_train, y_train) # Évaluation accuracy = model.score(X_test, y_test) print(f »Précision du modèle : {accuracy:.2f} ») |

✔ Avec TensorFlow (Exemple : Réseau de Neurones)

Python |

model = tf.keras.Sequential([ tf.keras.layers.Dense(128, activation=’relu’, input_shape=(X_train.shape[1],)), tf.keras.layers.Dense(64, activation=’relu’), tf.keras.layers.Dense(1, activation=’sigmoid’) ]) model.compile(optimizer=’adam’, loss=’binary_crossentropy’, metrics=[‘accuracy’]) model.fit(X_train, y_train, epochs=10, batch_size=32, validation_data=(X_test, y_test)) |

4. Sauvegarder et charger le modèle mis à jour

Après l’entraînement, pensez à sauvegarder le modèle pour une réutilisation future.

Sauvegarde avec Scikit-Learn

Python |

import joblib joblib.dump(model, « model.pkl ») |

Sauvegarde avec TensorFlow

Python |

model.save(« model.h5 ») |

Et pour le recharger :

Python |

from tensorflow.keras.models import load_model model = load_model(« model.h5 ») |

Résumé : Étapes pour ajouter des données à une machine d’apprentissage locale

– Collecter et nettoyer les données

– Charger les données dans un format compatible

– Diviser les données en train/test

– Entraîner le modèle avec les nouvelles données

– Sauvegarder le modèle mis à jour pour future utilisation

=>

=>

PRÉPARATION POUR IA GÉNÉRATIVE

=>

Dans le cas d’une IA générative, ajouter des données implique généralement de finetuner un modèle pré-entraîné ou de l’entraîner à partir de zéro selon l’architecture utilisée (GAN, VAE, Transformers comme GPT, Stable Diffusion, etc.).

1. Définir l’objectif du modèle génératif

– Texte (Chatbot, génération de contenu) → GPT, Llama, Mistral

– Image (Art, design, photos réalistes) → Stable Diffusion, DALL·E, StyleGAN

– Audio (Voix, musique) → AudioLM, VITS

– Vidéo (Animation, deepfake) → Runway, Video Diffusion Models

2. Préparer et structurer les données

Pour le texte → Dataset structuré en format JSON, CSV, TXT

- Exemple (GPT) :

Json |

{« prompt »: « Décris un dragon majestueux », « completion »: « Un dragon aux écailles dorées vole au-dessus des montagnes… »} |

Pour les images → Dossiers organisés + métadonnées (JSON, CSV)

- Exemple (Stable Diffusion) :

Python |

/dataset/dragons/ ├── image1.jpg ├── image2.jpg ├── metadata.json {« file_name »: « image1.jpg », « caption »: « Un dragon rouge crachant du feu »} |

Pour l’audio → WAV, MP3 + transcriptions

- Exemple (TTS) :

Python |

/dataset/voices/ ├── speech1.wav ├── transcript1.txt « Bonjour, voici un exemple de voix synthétique. » |

3. Intégrer les nouvelles données dans l’IA générative

a) Fine-tuning avec Hugging Face (Texte)

Si vous utilisez GPT, Llama, Mistral, vous pouvez finetuner un modèle pré-entraîné sur vos données :

Installation :

Python |

pip install transformers datasets peft Préparation des données : from datasets import load_dataset dataset = load_dataset(« json », data_files= »data.json ») |

Fine-tuning :

Python |

from transformers import AutoModelForCausalLM, TrainingArguments, Trainer model = AutoModelForCausalLM.from_pretrained(« mistralai/Mistral-7B ») trainer = Trainer(model=model, train_dataset=dataset) trainer.train() |

b) Fine-tuning Stable Diffusion (Images)

Pour ajouter vos propres images à Stable Diffusion, utilisez LoRA ou DreamBooth.

Installation :

Python |

pip install diffusers accelerate transformers |

Exemple avec diffusers :

Python |

from diffusers import StableDiffusionPipeline pipeline = StableDiffusionPipeline.from_pretrained(« runwayml/stable-diffusion-v1-5 ») pipeline.train(« dataset/dragons/ ») pipeline.save_pretrained(« custom_model/ ») |

) Fine-tuning AudioLM ou TTS (Voix)

Pour entraîner un modèle Text-to-Speech comme VITS :

Python |

from TTS.api import TTS tts = TTS(« vits », checkpoint_path= »model.pth ») tts.train(« dataset/voices/ ») |

4. Sauvegarde et utilisation du modèle mis à jour

Après l’entraînement, pensez à sauvegarder le modèle et à l’utiliser dans vos projets.

Sauvegarde du modèle

Python |

model.save_pretrained(« my_custom_model/ ») |

Utilisation du modèle

Python |

from transformers import AutoModelForCausalLM, AutoTokenizer model = AutoModelForCausalLM.from_pretrained(« my_custom_model/ ») tokenizer = AutoTokenizer.from_pretrained(« mistralai/Mistral-7B ») input_text = « Décris un dragon magique » tokens = tokenizer(input_text, return_tensors= »pt ») output = model.generate(**tokens) print(tokenizer.decode(output[0])) |

5. Optimisation et déploiement

Une fois les nouvelles données intégrées, vous pouvez :

– Tester le modèle sur des prompts spécifiques

– Optimiser les performances (quantization, pruning)

– Déployer en API via FastAPI, Gradio, Hugging Face Spaces

– Exporter pour un usage local ou cloud (ex : ONNX, TorchScript)

Résumé des étapes pour ajouter des données à une IA générative

– Collecter et formater les nouvelles données (texte, image, audio, etc.)

– Charger les données et structurer le dataset

– Fine-tuner un modèle existant (GPT, SD, AudioLM, etc.)

– Sauvegarder et tester le modèle mis à jour

– Optimiser et déployer pour l’exploitation.

=>

=>

UTILISATION D’UN GPT

Guide détaillé pour ajouter des données et fine-tuner un modèle GPT en local.

1. Définir l’objectif du fine-tuning

Pourquoi veux-tu ajouter des données ?

✔ Adapter GPT à un domaine spécifique (ex : communication, marketing, technique)

✔ Améliorer la cohérence sur un ton ou un style précis

✔ Personnaliser les réponses selon une charte éditoriale

2. Préparer les données

GPT utilise un format structuré pour l’apprentissage, généralement du JSONL (JSON Lines).

Exemple de format JSONL pour le fine-tuning

Chaque ligne correspond à un exemple d’entraînement :

Json |

{« messages »: [{« role »: « system », « content »: « Tu es un assistant spécialisé en IA générative. »}, {« role »: « user », « content »: « Comment ajouter des données à un modèle GPT ? »}, {« role »: « assistant », « content »: « Pour ajouter des données à GPT, il faut préparer un dataset JSONL… » }]} |

role: system → Définit le comportement de GPT

role: user → Représente les entrées de l’utilisateur

role: assistant → Réponses attendues

Étape clé : Crée un dataset avec plusieurs exemples réalistes, alignés avec ton objectif.

3. Lancer l’entraînement en local

Tu peux fine-tuner GPT-3.5 ou GPT-4 via OpenAI API ou entraîner un modèle open-source comme Mistral/LLaMA avec Hugging Face.

Option 1 : Fine-tuning GPT via OpenAI

Installation

Assure-toi d’avoir l’API OpenAI installée :

Bash |

pip install openai |

Charger les données dans OpenAI

Bash |

openai tools fine_tunes.prepare_data -f dataset.jsonl |

Lancer l’entraînement

Bash |

openai api fine_tunes.create -t « dataset_prepared.jsonl » -m gpt-3.5-turbo |

Utiliser le modèle fine-tuné

Python |

import openai response = openai.ChatCompletion.create( model= »ft:gpt-3.5-turbo:mon_modele », messages=[{« role »: « user », « content »: « Comment ajouter des données à GPT ? »}] ) print(response[« choices »][0][« message »][« content »]) |

Option 2 : Fine-tuning un modèle open-source (Mistral, LLaMA)

Si tu veux fine-tuner un modèle open-source en local, voici une méthode avec Hugging Face.

Installation

Python |

pip install transformers datasets peft |

Charger les données

Python |

from datasets import load_dataset dataset = load_dataset(« json », data_files= »dataset.jsonl ») |

Fine-tuner Mistral-7B (exemple)

Python |

from transformers import AutoModelForCausalLM, TrainingArguments, Trainer model = AutoModelForCausalLM.from_pretrained(« mistralai/Mistral-7B ») trainer = Trainer(model=model, train_dataset=dataset) trainer.train() |

4. Tester et déployer le modèle

Après le fine-tuning, pense à tester ton modèle avec des prompts réels et à l’optimiser (quantization, distillation). Tu peux aussi le déployer en API via FastAPI, Gradio ou Hugging Face Spaces.